| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | ||

| 6 | 7 | 8 | 9 | 10 | 11 | 12 |

| 13 | 14 | 15 | 16 | 17 | 18 | 19 |

| 20 | 21 | 22 | 23 | 24 | 25 | 26 |

| 27 | 28 | 29 | 30 |

- 인공지능

- tts

- LORA

- 오픈AI

- 일론 머스크

- 오블완

- OpenAI

- 실시간 렌더링

- 강화 학습

- 아두이노

- OpenCV

- 휴머노이드 로봇

- AI 기술

- PYTHON

- 티스토리챌린지

- 오픈소스

- 이미지 생성

- 우분투

- 메타

- TRANSFORMER

- AI

- 시간적 일관성

- 생성형 AI

- ChatGPT

- 확산 모델

- 딥러닝

- LLM

- 멀티모달

- 다국어 지원

- 트랜스포머

- Today

- Total

AI 탐구노트

VRAM 96GB를 가진 RTX4090? 본문

X에서 신기한 글을 하나 봤습니다. Nvidia RTX4090에 96GB의 VRAM을 달아서 사용하는 사례였습니다.

X의 青龍聖者님(@bdsqlsz)

4090 96gb verify.😎

x.com

글을 내용을 봐서는 중국 쪽 분의 게시글 같았는데 증빙을 하느라 실제 돌아가는 화면과 사진을 첨부했습니다.

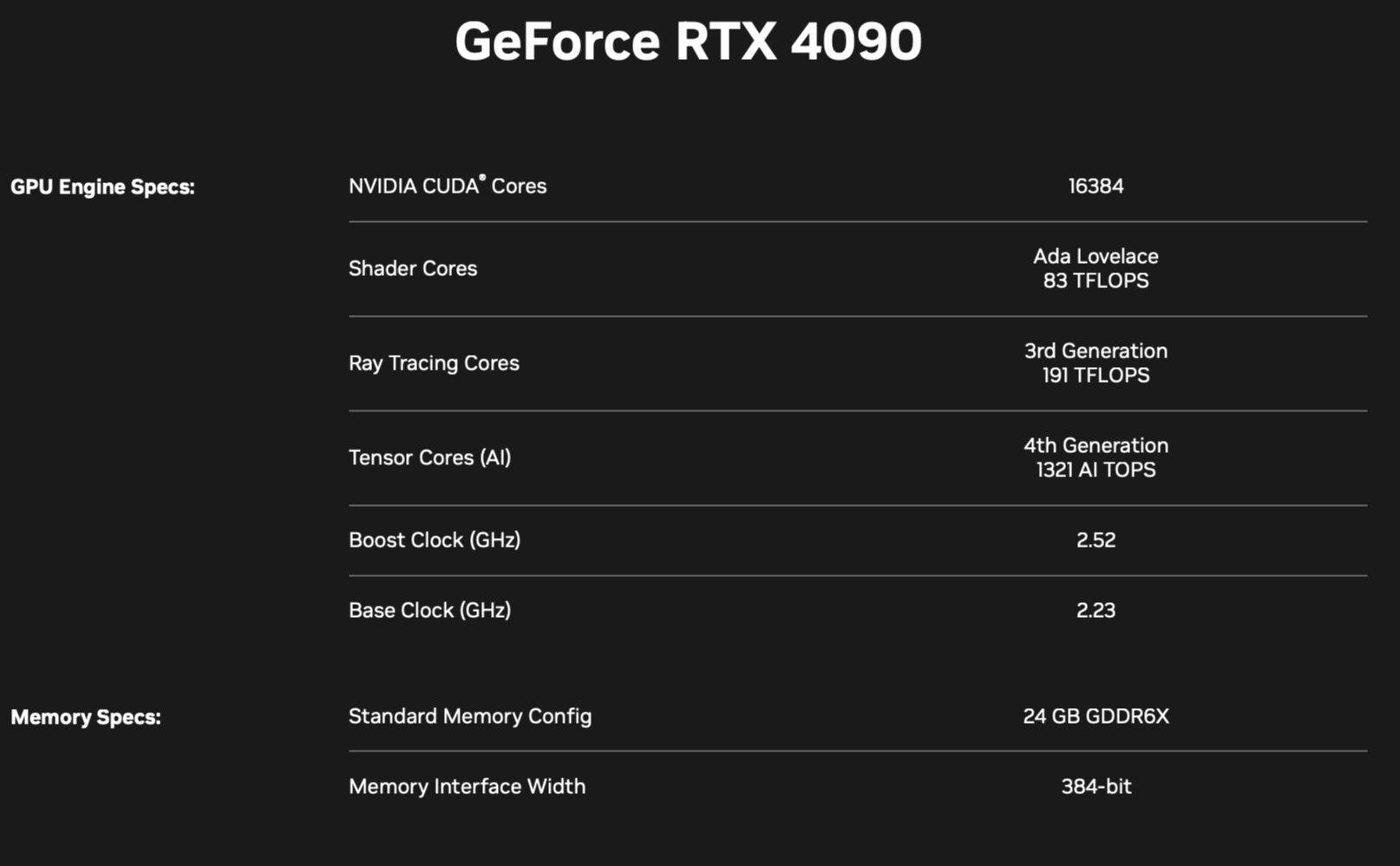

NVIDIA에서 정상적으로 판매하는 제품은 RTX4090에는 24GB VRAM만 존재하므로 이 사진이 정말이라면 물리적으로 VRAM을 추가하도록 개조한 것으로 볼 수 있습니다.

최근 생성형 AI나 LLM을 개발하기 위해서는 GPU의 코어 성능, 메모리 대역폭도 중요하지만 사용가능한 VRAM 용량도 그 못지않게 중요해졌습니다. 참고로 고가형 GPU들 가운데 A100, H100은 80GB, 최신 H200은 141GB 의 VRAM을 가진 것으로 알려져 있죠.

판매 가격 또한 24GB 짜리 공식 제품이 $1500 가량 하는 것 대비 $3700이면 2배가 훨씬 넘어갑니다. 홈페이지 상의 공식 판매가보다 실제 국가 별 판매가가 대부분 더 높으니 실제로는 1.x 배 정도 한다고 생각하면 되겠죠. 참고로 현재 쿠팡에서는 320만원 선에 거래되고 있답니다. 32GB VRAM을 가진 신형 RTX5090은 사재기 때문인지 거의 700만원에 가까운 가격에 판매되고 있구요.

예전에도 중국에서 발매된 아이폰의 메모리를 교체하는 방식으로 용량을 높여서 판매하는 사례가 있었던터라, 사례는 다르지만 GPU 메모리도 그렇게 할 수 있는 방법을 찾은게 아닌가 추측해 볼 수 있을 것 같습니다. 물리적 메모리 칩만 바꾼다고 자동으로 인식하는 것은 아니므로 펌웨어 등을 다룰 수 있는 방법도 찾았다는 얘기겠죠.

문제는 이렇게 불법적으로 개조해서 판매하는 곳이 있다는 것보다는, VRAM을 충분히 늘릴 수 있었을 NVIDIA가 자사 제품의 판매를 늘이기 위해 더 적은 용량의 VRAM만 장착해서 판매하고 있는게 아닌가 하는 곱지 않은 시선이 생길 수 밖에 없다는 것입니다. 세계적으로 GPU 수요는 넘쳐나고 그걸 제조, 공급할 수 있는 곳은 자신들 뿐이니 이런 판단을 해도 뭐라 할 수도 없습니다. 하지만, 약오르고 괘씸하다는 생각이 드는 것은 어쩔 수 없네요. AMD이건 Intel이건 NPU 업체이건 CUDA 생태계를 대체하면서 성능도 뛰어난 GPU를 출시하는 곳이 얼른 나왔으면 좋겠습니다.

'AI 관련 소식' 카테고리의 다른 글

| AI가 대체하는 인간의 일과 기회: 위기인가, 새로운 시작인가? (1) | 2025.03.15 |

|---|---|

| 인공지능(AI) 서비스의 신뢰성, 어떻게 확보할 수 있을까? (2) | 2025.03.13 |

| Manus : 새로운 AI Agent, 또 하나의 Deepseek 모멘트? (0) | 2025.03.11 |

| AI 에이전트 기술의 상용화, 대중화 시작 (0) | 2025.03.10 |

| [오늘의 AI/IT 관심 뉴스] 2025.3.10 (2) | 2025.03.10 |