| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | ||

| 6 | 7 | 8 | 9 | 10 | 11 | 12 |

| 13 | 14 | 15 | 16 | 17 | 18 | 19 |

| 20 | 21 | 22 | 23 | 24 | 25 | 26 |

| 27 | 28 | 29 | 30 |

- 아두이노

- 오블완

- AI 기술

- OpenAI

- TRANSFORMER

- PYTHON

- 생성형 AI

- 이미지 생성

- 확산 모델

- 휴머노이드 로봇

- OpenCV

- AI

- 오픈소스

- 인공지능

- 강화 학습

- 트랜스포머

- LORA

- 메타

- 시간적 일관성

- nvidia

- LLM

- ubuntu

- 딥러닝

- ChatGPT

- tts

- 우분투

- 티스토리챌린지

- 다국어 지원

- 일론 머스크

- 오픈AI

- Today

- Total

AI 탐구노트

Gaze-LLE : 대규모 학습 인코더를 활용한 시선 대상 추정 본문

1. 서론

사람이 어디를 보고 있는지를 추적하는 기술은 우리가 주변 세계와 상호작용하는 방식을 이해하는 데 중요한 역할을 합니다. 예를 들어, 대화 중 상대방의 시선 방향은 그들이 관심을 가지고 있는 대상을 파악하거나 의도를 추측하는 데 도움을 줍니다. 이런 기술은 특히 인간-컴퓨터 상호작용, 자율주행, 로봇 비전, 혹은 광고 효과 분석 등 다양한 분야에서 응용될 수 있습니다.

과거에는 시선 방향을 추적하기 위해 여러 종류의 데이터를 분석하고 조합하는 복잡한 시스템이 주로 사용되었습니다. 하지만 이러한 방식은 개발이 어렵고 많은 비용이 들며, 데이터가 부족한 환경에서는 정확도가 떨어지는 한계가 있었습니다. 최근에는 대규모 데이터를 바탕으로 학습된 인공지능 모델들이 여러 시각적 문제를 해결하는 데 매우 좋은 성과를 보이고 있습니다.

이 논문에서는 이러한 트렌드에 맞춰, Gaze-LLE라는 새로운 기술을 제안합니다. Gaze-LLE는 미리 학습된 대규모 모델을 활용해 시선 추적 기술의 복잡함을 줄이고, 성능을 더욱 향상시키는 방법을 제시합니다. 이 글에서는 Gaze-LLE의 구조와 특징을 살펴보고, 이 기술이 기존 방식보다 어떤 점에서 더 뛰어난지 설명하겠습니다.

2. 본론

2.1 기존 방식의 문제점

이전에는 사람의 머리 위치, 장면의 배경 정보, 추가 데이터(예: 깊이 정보, 신체 자세)를 따로 분석한 뒤, 이를 결합해 시선을 추적하는 복잡한 구조의 시스템이 사용되었습니다. 이런 방식은 다양한 데이터를 동시에 분석해야 하므로 구현이 어렵고, 대량의 학습 데이터가 필요했으며, 실행 속도도 느린 편이었습니다. 결과적으로 이런 시스템은 특정 데이터셋에만 잘 작동하거나, 실제 환경에서 사용할 때 성능이 저하되는 경우가 많았습니다.

2.2 접근 방식

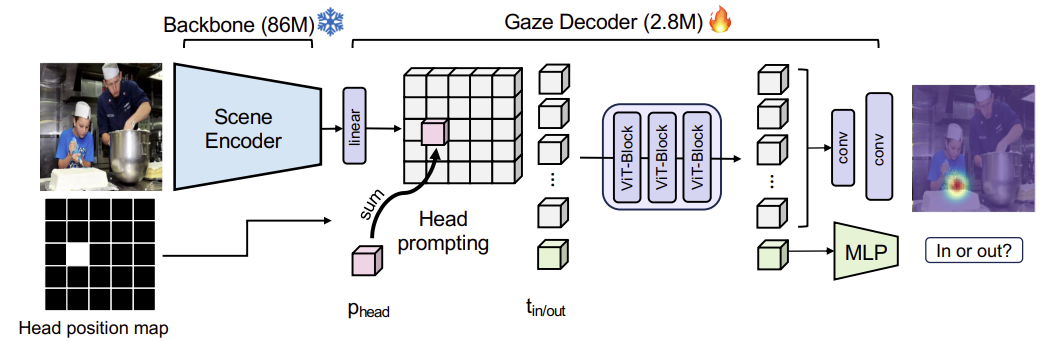

Gaze-LLE는 이러한 문제를 해결하기 위해, 이미 대규모 데이터로 학습된 DINOv2라는 모델을 활용하여 시선 추적 시스템을 간소화했습니다. 이 모델은 이미지나 동영상에서 중요한 정보를 자동으로 뽑아낼 수 있는 강력한 기술을 제공하며, Gaze-LLE는 이를 활용해 간단하면서도 효과적인 시선 추적 방식을 구현했습니다.

- 머리 위치 정보 활용

Gaze-LLE는 사람의 머리가 화면에서 어디에 있는지를 이용하여 시선 추적의 정확도를 높였습니다. 기존 방식에서는 머리 위치를 직접 분석하는 별도의 처리 과정이 필요했지만, Gaze-LLE는 이 정보를 간단한 입력값으로 추가하여 시스템의 복잡도를 줄였습니다. - 간단한 결과 해석 기술

Gaze-LLE는 미리 학습된 모델에서 얻은 정보를 바탕으로, 간단한 연산 과정을 통해 시선의 방향을 추정합니다. 이를 통해 복잡한 추가 모델이나 계산 과정을 생략할 수 있었습니다.

2.3 세부 적용 기술

- 미리 학습된 DINOv2 인코더 모델 활용

Gaze-LLE는 DINOv2라는 기존에 학습된 모델을 사용해 장면의 전체 이미지를 분석합니다. 이 모델은 복잡한 추가 학습 없이도 이미지를 이해하는 데 필요한 중요한 정보를 제공합니다. - 머리 위치를 활용한 간단한 입력 처리

사람의 머리가 화면에서 어디에 있는지를 알려주는 정보를 추가하여, 분석할 대상을 명확히 지정합니다. 이 방식은 시선을 추적하려는 사람이 여러 명일 때도 효율적으로 작동합니다. - 간단한 결과 생성 방법으로 경량 디코더 설계

Gaze-LLE는 복잡한 계산 없이도 정확한 결과를 얻기 위해 설계된 단순화된 결과 생성 과정을 포함합니다. 이를 통해 계산 속도가 빨라지고, 기존 방식보다 학습과 실행에 필요한 자원이 적어졌습니다. 즉, DINOv2에서 추출된 특징 맵은 소형 트랜스포머 디코더를 통해 시선 추정 결과로 변환되는데, 이 디코더는 장면 정보와 머리 위치 정보를 결합해 출력 히트맵(heatmap)을 생성하며, 높은 정확도를 유지하면서도 파라미터 수를 기존 대비 약 95% 줄였습니다. - 효율적인 학습 프로세스

Gaze-LLE는 기존의 복잡한 손실 계산 방식이나 추가 모델을 요구하지 않으므로, 한정된 컴퓨팅 자원으로도 빠르게 학습할 수 있습니다. 예를 들어, 고성능 GPU 한 대로 약 1.5시간 내에 학습을 완료할 수 있습니다.

2.4 제약사항

Gaze-LLE가 사용하는 대규모 모델은 뛰어난 성능을 제공하지만, 모델의 크기와 계산 요구량이 많아 일부 저성능 장치에서는 사용이 어려울 수 있습니다. 하지만 더 효율적인 모델이 개발될수록 Gaze-LLE의 효율성은 더욱 높아질 가능성이 있습니다.

3. 결론

Gaze-LLE는 대규모 학습된 인코더를 활용하여 시선 대상 추정에서 기존 복잡한 구조를 간소화하고, 효율성과 정확도를 모두 개선한 혁신적인 프레임워크입니다. 본 연구는 시선 추정을 포함한 여러 시각적 작업에서 기초 모델 기반 접근의 가능성을 보여줍니다.

기존에 카메라 기반 기술은 정확도가 낮고 실시간 처리를 하기에는 많은 컴퓨팅 자원이 필요했기 때문에 산업 도메인에 적용하는데는 어려움이 있었습니다. 그래서 대부분 안경 스타일로 제작되어 장착된 카메라의 FoV와 눈동자의 움직임 분석을 이용하는 방식이나 혹은 스크린 상에 표시된 컨텐츠를 보는 시선 추정을 이용하는 정도로 접근하곤 했었습니다.

Gaze-LLE는 이런 제약을 해결해서 다양한 분야에 확장할 수 있는 길을 열었다고 볼 수 있습니다. 물론 더 나은 기술들이 또 등장하겠지만, 나아갈 방향을 가리키고 있다고 할 수 있겠죠. 앞으로 이러한 방식이 더욱 다양한 응용 분야로 확장되는 모습을 또 기대해 보겠습니다.

4. 참고자료

- Gaze-LLE 논문 원문 (링크)

- Gaze-LLE 코드 (Github) : MIT 라이선스로 공개되어 있습니다.

GitHub - fkryan/gazelle

Contribute to fkryan/gazelle development by creating an account on GitHub.

github.com

- 데모 코드 (Colab Notebook)

- 기사

5. Q&A

Q. Gaze-LLE가 기존 모델보다 우수한 이유는 무엇인가요?

미리 학습된 대규모 모델을 활용하여 복잡한 추가 처리 과정을 제거했기 때문입니다. 이로 인해 학습 속도가 빨라지고 시스템 구현도 쉬워졌습니다.

Q. DINOv2 대신 다른 인코더를 사용할 수 있나요?

가능합니다. DINOv2 외에도 CLIP 같은 다른 대규모 모델도 사용 가능하며, 각각의 모델에 따라 성능은 다를 수 있습니다.

Q. Gaze-LLE는 어떤 응용 분야에 적합한가요?

사람의 시선을 추적해야 하는 모든 상황에 적합합니다. 예를 들어, 소셜 미디어, 화상회의, 자율주행 차량, 로봇과의 상호작용 등 다양한 환경에서 사용할 수 있습니다.

'AI 기술' 카테고리의 다른 글

| 자동 악보 전사 (Automatic Notes Trascription): 들리는 것을 보이는 것으로 바꾸는 기술 (1) | 2024.12.23 |

|---|---|

| TGH : 긴 볼류메트릭 비디오를 효율적으로 표현하는 시간적 가우시안 계층 구조 (6) | 2024.12.16 |

| DeepSVG : 벡터 그래픽 생성과 애니메이션을 위한 계층적 생성 네트워크 (3) | 2024.12.14 |

| 다양한 입력 이미지를 위한 범용 가상 스케치 프레임워크 (2) | 2024.12.13 |

| Im2Vec : 이미지로부터 벡터 그림 만들기 (1) | 2024.12.13 |