| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | 6 | 7 |

| 8 | 9 | 10 | 11 | 12 | 13 | 14 |

| 15 | 16 | 17 | 18 | 19 | 20 | 21 |

| 22 | 23 | 24 | 25 | 26 | 27 | 28 |

| 29 | 30 |

- 우분투

- 확산 모델

- gaussian splatting

- 메타

- LLM

- OpenCV

- LORA

- 트랜스포머

- ai 챗봇

- 휴머노이드 로봇

- OpenAI

- 멀티모달

- 실시간 렌더링

- 일론 머스크

- ChatGPT

- 오픈AI

- 오블완

- 시간적 일관성

- 딥러닝

- 강화 학습

- tts

- AI

- PYTHON

- 티스토리챌린지

- 생성형AI

- AI 기술

- 자연어 처리

- XAI

- 오픈소스

- 인공지능

- Today

- Total

AI 탐구노트

4DGS-1K : 1000FPS 실시간 4D 장면 렌더링을 위한 초고속 Gaussian Splatting 기법 본문

가상현실(VR), 증강현실(AR), 3D 게임 그래픽 등에서 생생하고 사실적인 장면을 실시간으로 구현하는 기술은 날로 중요해지고 있습니다. 이러한 기술들은 대부분 시간에 따라 변하는 장면, 즉 '동적 장면'을 빠르고 정확하게 렌더링(rendering)하는 것을 목표로 합니다. 지금까지는 Neural Radiance Fields(NeRF)라는 기술이 주로 활용되어 왔지만, 이 방식은 처리 속도가 느리고 자원 소모가 커서 현실적인 적용에는 한계가 있었습니다.

최근에는 NeRF의 단점을 보완하기 위한 새로운 방식들이 등장하고 있으며, 그 중 하나가 바로 4D Gaussian Splatting(4DGS)입니다. 이 방식은 수많은 '가우시안 점'을 활용해 4차원(3D 공간 + 시간)의 정보를 표현하는 기술입니다. 하지만 이 역시 렌더링 속도와 저장 용량 측면에서 여러 문제점을 안고 있었죠.

'4DGS-1K'는 기존 4DGS의 단점을 극복하고, 초당 1000프레임 이상(FPS)의 렌더링 속도를 달성하는 새로운 접근법입니다.

4DGS-1K

1) 기존 방식의 문제점

기존의 4D Gaussian Splatting(4DGS) 방식은 뛰어난 화질의 동적 장면을 재구성할 수 있었지만, 몇 가지 치명적인 단점이 있었습니다.

- 저장 공간 낭비 : 복잡한 동적 장면을 표현하기 위해 수백만 개의 가우시안 점을 사용해야 했으며, 이로 인해 한 장면당 2GB 이상의 저장 공간이 필요했습니다.

- 느린 렌더링 속도 : 화면에 실제로 보이는 점은 일부에 불과한데도 모든 가우시안을 처리해야 하므로 불필요한 계산이 많아 속도가 느려졌습니다.

2) 접근 방식

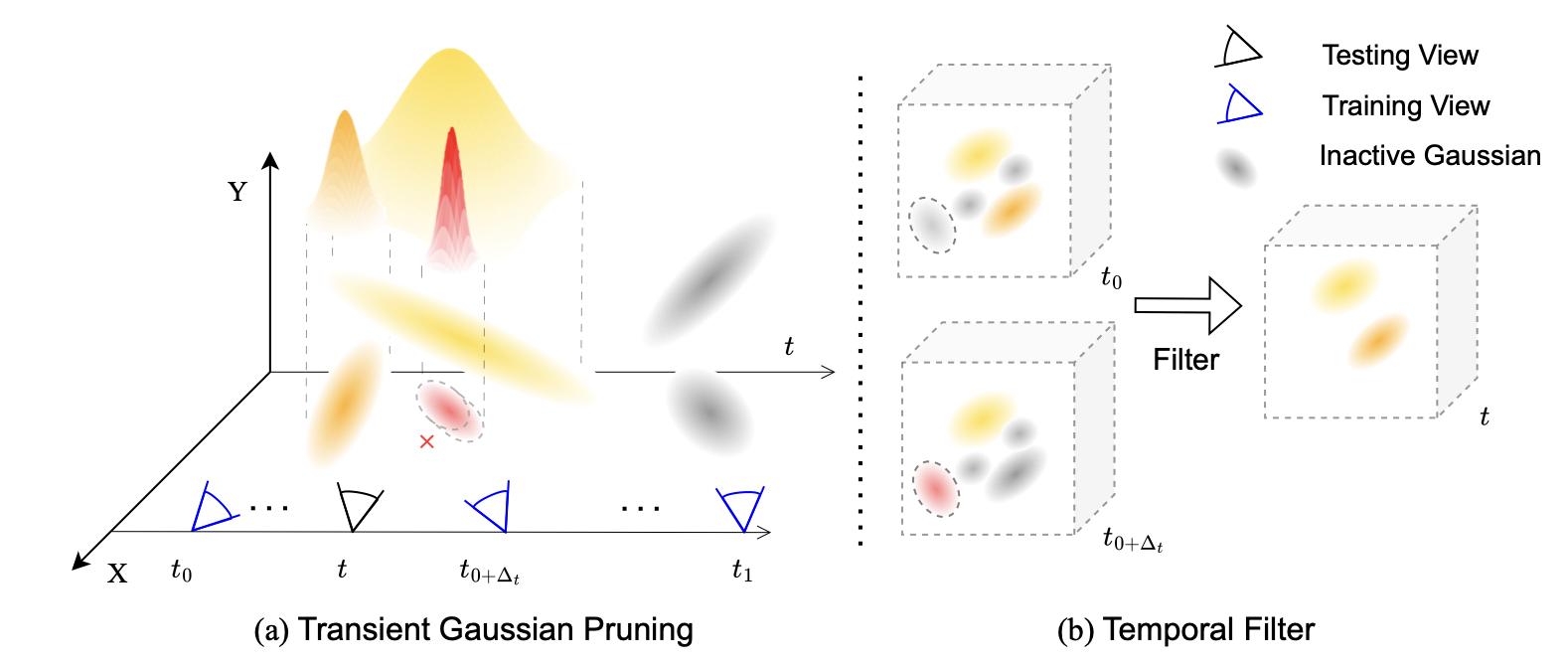

이 논문에서는 위의 문제를 해결하기 위해 "4DGS-1K"라는 새로운 프레임워크를 제안합니다. 핵심 아이디어는 크게 두 가지입니다.

- 불필요한 가우시안 제거(Pruning) : 시간적으로 짧은 순간에만 영향을 주는 '짧은 수명 가우시안(Short-Lifespan Gaussian)'을 제거합니다.

- 비활성 가우시안 필터링(Filtering) : 각 프레임에서 실제로 사용되는 가우시안만 처리하고, 나머지는 무시하여 연산을 줄입니다.

위 방식을 이용해 기존 4DGS 방식 대비 저장 용량은 2% 수준으로 줄고, 속도는 1000FPS 이상으로 빨라졌음을 보여주고 있습니다.

3) 세부 적용 기술

1️⃣ Spatial-Temporal Variation Score (공간-시간 변화 점수)

- 각 가우시안이 장면에 얼마나 많은 영향을 주는지를 평가하는 점수입니다.

- 공간적으로 얼마나 영향을 미쳤는지(Spatial Score)와 시간적으로 얼마나 오랫동안 활동했는지(Temporal Score)를 결합해 평가합니다.

- 이 점수가 낮은 가우시안은 중요하지 않다고 판단되어 제거됩니다.

2️⃣ Temporal Filtering (시간 기반 필터링)

- 특정 시점에 '활성화된' 가우시안만 선택적으로 처리합니다.

- 인접한 프레임에서 활성화된 가우시안이 거의 겹친다는 점에 착안하여, 키프레임 기반으로 마스크를 공유함으로써 불필요한 연산을 줄입니다.

위의 그림은 4DGS-1K의 전체 아키텍처를 시각화한 그림으로, 훈련 뷰에서 중요 가우시안을 선별하고, 테스트 뷰에서는 필터링을 통해 빠르게 렌더링하는 것을 보여줍니다.

4) 제약사항

- 필터링 간격이 너무 길면 중요한 가우시안이 누락되어 품질이 저하될 수 있습니다.

- 각 장면에 적합한 '최적의 제거 비율'을 사전에 설정해야 하는데, 이는 경험적으로 조정이 필요합니다.

4DGS-1K는 기존 4D Gaussian Splatting의 두 가지 큰 문제인 저장 공간 낭비와 느린 렌더링 속도를 획기적으로 개선했습니다. 제안된 방법을 통해 기존 대비 최대 41배 저장 용량 절감, 9배 빠른 속도를 달성하면서도 화질은 거의 손실 없이 유지했습니다.

실생활에서는 VR 게임, 실시간 영상 합성, AR 콘텐츠 생성 등 다양한 분야에 바로 적용될 수 있습니다. 특히 저사양 장비에서도 고속 렌더링이 가능하다는 점에서 큰 장점을 가집니다.

향후에는 보다 일반적인 Gaussian 모델에도 적용 가능한 범용적인 압축 기법으로 확장될 수 있을 것입니다.

참고자료

- 사이트) 4DGS-1K 프로젝트 페이지 (링크)

- 논문) 1000+ FPS 4D Gaussian Splatting for Dynamic Scene Rendering (2025) (링크)

Q&A

Q. 왜 4D Gaussian Splatting은 많은 가우시안이 필요했나요?

짧은 시간 동안만 영향을 주는 '짧은 수명 가우시안'이 많아서, 장면 전체를 표현하기 위해서는 수백만 개의 가우시안이 필요했습니다.

Q. 새롭게 제안된 Spatial-Temporal Variation Score는 무엇을 의미하나요?

각 가우시안이 공간과 시간적으로 장면에 미치는 영향을 정량적으로 평가하는 점수로, 중요하지 않은 가우시안을 제거하는 기준이 됩니다.

Q. 4DGS-1K는 어디에 활용될 수 있나요?

VR/AR, 3D 영상 편집, 실시간 게임 그래픽 등에서 고속 렌더링이 필요한 다양한 응용 분야에 사용될 수 있습니다.

'AI 기술' 카테고리의 다른 글

| GAIA-2 : 자율주행을 위한 혁신적인 비디오 생성 세계 모델 (0) | 2025.04.02 |

|---|---|

| LHM : 단일 이미지로 애니메이션 가능한 3D 인간 아바타를 생성하는 모델 (0) | 2025.04.01 |

| 모션 제너레이션의 새로운 지평: Motion Anything (0) | 2025.03.29 |

| KDTalker : 음성 기반 고화질 인물 영상 생성 (0) | 2025.03.29 |

| TaoAvatar: AR 환경에서 실시간으로 말하는 3D 아바타 만들기 (0) | 2025.03.28 |